# GLM-4.7-Flash: ローカルで実行する方法

GLM-4.7-Flash は、ローカル展開向けに構築された Z.ai の新しい 30B MoE 推論モデルで、コーディング、エージェント的ワークフロー、チャットにおいてクラス最高の性能を提供します。約 3.6B のパラメータを使用し、200K のコンテキストをサポートし、SWE-Bench、GPQA、推論/チャットのベンチマークをリードします。

GLM-4.7-Flash は **24GB RAM**/VRAM/ユニファイドメモリ上で動作します(完全精度では 32GB)。また、現在は Unsloth でファインチューニングできます。vLLM で GLM 4.7 Flash を実行するには、こちらを参照してください [#glm-4.7-flash-in-vllm](#glm-4.7-flash-in-vllm "mention")

{% hint style="success" %}

1月21日更新: `llama.cpp` 誤った `scoring_func`: `"softmax"` を指定していたバグを修正しました( `"sigmoid"`であるべきでした)。これによりループと出力品質の低下が発生していました。GGUF を更新したので、より良い出力のためにモデルを再ダウンロードしてください。

Z.ai 推奨のパラメータを使って、優れた結果を得られるようになりました:

* **一般的な用途では:** `--temp 1.0 --top-p 0.95`

* **ツール呼び出しでは:** `--temp 0.7 --top-p 1.0`

* **リピートペナルティ:** 無効にするか、 `--repeat-penalty 1.0`

1月22日: CUDA 向けの FA 修正がマージされたため、より高速な推論が利用可能になりました。

{% endhint %}

実行チュートリアルファインチューニング

実行する GLM-4.7-Flash GGUF: [unsloth/GLM-4.7-Flash-GGUF](https://huggingface.co/unsloth/GLM-4.7-Flash-GGUF)

### ⚙️ 使用ガイド

最高の性能を得るには、利用可能な総メモリ(VRAM + システムRAM)が、ダウンロードする量子化モデルファイルのサイズを上回っていることを確認してください。上回っていない場合でも、llama.cppはSSD/HDDオフロードで実行できますが、推論は遅くなります。

Z.ai チームと話した結果、彼らは GLM-4.7 のサンプリングパラメータを使うことを推奨しています:

| デフォルト設定(ほとんどのタスク) | Terminal Bench、SWE Bench Verified |

| ------------------------------------------------------------------ | ------------------------------------------------------------------ |

| **temperature = 1.0** | **temperature = 0.7** |

| **top\_p = 0.95** | **top\_p = 1.0** |

| repeat penalty = 無効または 1.0 | repeat penalty = 無効または 1.0 |

* 一般的な用途では: `--temp 1.0 --top-p 0.95`

* ツール呼び出しでは: `--temp 0.7 --top-p 1.0`

* llama.cpp を使う場合は、 `--min-p 0.01` を設定してください。llama.cpp のデフォルトは 0.05 です。

* 用途によって最適な数値を見つけるため、試行錯誤が必要な場合があります。

{% hint style="warning" %}

現時点では、 **推奨しません** この GGUF を **Ollama** で実行することは、チャットテンプレートの互換性問題が発生する可能性があるためです。GGUF は llama.cpp(または LM Studio、Jan などのバックエンド)ではうまく動作します。

**リピートペナルティを無効にするのを忘れないでください!または** `--repeat-penalty 1.0`

{% endhint %}

* **最大コンテキストウィンドウ:** `202,752`

### 🖥️ GLM-4.7-Flash を実行

ユースケースによっては、異なる設定を使う必要があります。いくつかのGGUFは、モデルアーキテクチャ(たとえば [gpt-oss](https://unsloth.ai/docs/jp/moderu/gpt-oss-how-to-run-and-fine-tune))に128で割り切れない次元があるため、パーツをより低いビット数に量子化できず、結果としてサイズが似通うことがあります。

このガイドは 4-bit を使用しているため、約 18GB の RAM/ユニファイドメモリが必要です。最高の性能を得るには、少なくとも 4-bit 精度を使うことを推奨します。

{% hint style="warning" %}

現時点では、 **推奨しません** この GGUF を **Ollama** で実行することは、チャットテンプレートの互換性問題が発生する可能性があるためです。GGUF は llama.cpp(または LM Studio、Jan などのバックエンド)ではうまく動作します。

**リピートペナルティを無効にするのを忘れないでください!または** `--repeat-penalty 1.0`

{% endhint %}

#### 🦥 Unsloth Studioガイド

GLM-4.7-Flash は、 [Unsloth Studio](https://unsloth.ai/docs/jp/xin-zhe/studio)で実行およびファインチューニングできます。これはローカルAI向けの新しいオープンソースWeb UIです。Unsloth Studioを使えば、モデルをローカルで **MacOS、Windows**、Linuxおよび以下で実行できます:

{% columns %}

{% column %}

* GGUFと [GGUFを実行](https://unsloth.ai/docs/jp/xin-zhe/studio#run-models-locally) およびsafetensorモデルを検索・ダウンロード

* [**自己修復** ツール呼び出し](https://unsloth.ai/docs/jp/xin-zhe/studio#execute-code--heal-tool-calling) + **Web検索**

* [**コード実行**](https://unsloth.ai/docs/jp/xin-zhe/studio#run-models-locally) (Python、Bash)

* [自動推論](https://unsloth.ai/docs/jp/xin-zhe/studio#model-arena) パラメータ調整(temp、top-pなど)

* llama.cpp経由の高速CPU + GPU推論

* [LLMを学習](https://unsloth.ai/docs/jp/xin-zhe/studio#no-code-training) VRAMを70%削減しつつ2倍高速

{% endcolumn %}

{% column %}

{% endcolumn %}

{% endcolumns %}

{% stepper %}

{% step %}

**Unslothをインストール**

ターミナルで実行:

MacOS、Linux、WSL:

```bash

curl -fsSL https://unsloth.ai/install.sh | sh

```

Windows PowerShell:

```bash

irm https://unsloth.ai/install.ps1 | iex

```

{% hint style="success" %}

**インストールは迅速で、約1〜2分で完了します。**

{% endhint %}

{% endstep %}

{% step %}

**Unslothを起動**

MacOS、Linux、WSLおよびWindows:

```bash

unsloth studio -H 0.0.0.0 -p 8888

```

次に `http://localhost:8888` をブラウザで開きます。

{% endstep %}

{% step %}

**GLM-4.7-Flash を検索してダウンロード**

初回起動時に、アカウントを保護し後で再度サインインするためのパスワードを作成する必要があります。その後、モデル、データセット、基本設定を選ぶ簡単な初期設定ウィザードが表示されます。いつでもスキップできます。

次に [Studio Chat](https://unsloth.ai/docs/jp/xin-zhe/studio/chat) タブで検索し、 **GLM-4.7-Flash** を検索バーに入力して、必要なモデルと量子化版をダウンロードしてください。

{% endstep %}

{% step %}

**GLM-4.7-Flash を実行**

Unsloth Studioを使うと推論パラメータは自動設定されますが、手動で変更することもできます。コンテキスト長、チャットテンプレート、その他の設定も編集できます。

詳細は、こちらの [Unsloth Studio推論ガイド](https://unsloth.ai/docs/jp/xin-zhe/studio/chat).

{% endstep %}

{% endstepper %}

#### Llama.cpp チュートリアル(GGUF):

llama.cppで実行するための手順(ほとんどのデバイスに収まるよう、4ビットを使用します):

{% stepper %}

{% step %}

最新の `llama.cpp` を [GitHubこちら](https://github.com/ggml-org/llama.cpp)から入手してください。下のビルド手順に従うこともできます。 `-DGGML_CUDA=ON` を `-DGGML_CUDA=OFF` に変更してください。GPUがない場合やCPU推論だけを使いたい場合です。 **Apple Mac / Metalデバイスでは**、 `-DGGML_CUDA=OFF` を設定してから通常どおり続行してください。Metalサポートはデフォルトで有効です。

{% code overflow="wrap" %}

```bash

apt-get update

apt-get install pciutils build-essential cmake curl libcurl4-openssl-dev -y

git clone https://github.com/ggml-org/llama.cpp

cmake llama.cpp -B llama.cpp/build \\

-DBUILD_SHARED_LIBS=OFF -DGGML_CUDA=ON

cmake --build llama.cpp/build --config Release -j --clean-first --target llama-cli llama-mtmd-cli llama-server llama-gguf-split

cp llama.cpp/build/bin/llama-* llama.cpp

```

{% endcode %}

{% endstep %}

{% step %}

Hugging Face から直接取得できます。RAM/VRAM が許す範囲でコンテキストを 200K まで増やせます。

Z.ai 推奨の GLM-4.7 サンプリングパラメータも試せます:

* 一般的な用途では: `--temp 1.0 --top-p 0.95`

* ツール呼び出しでは: `--temp 0.7 --top-p 1.0`

* **リピートペナルティを無効にするのを忘れないでください!**

以下を **一般的な命令** のユースケースを実行します:

```bash

./llama.cpp/llama-cli \\

-hf unsloth/GLM-4.7-Flash-GGUF:UD-Q4_K_XL \

--ctx-size 16384 \\

--temp 1.0 --top-p 0.95 --min-p 0.01

```

以下を **ツール呼び出し** のユースケースを実行します:

```bash

./llama.cpp/llama-cli \\

-hf unsloth/GLM-4.7-Flash-GGUF:UD-Q4_K_XL \

--ctx-size 16384 \\

--temp 0.7 --top-p 1.0 --min-p 0.01

```

{% endstep %}

{% step %}

(のインストール後に)モデルをダウンロードします `pip install huggingface_hub`)。 `UD-Q4_K_XL` または他の量子化版。ダウンロードが止まる場合は、こちらを参照してください [hugging-face-hub-xet-debugging](https://unsloth.ai/docs/jp/ji-ben/troubleshooting-and-faqs/hugging-face-hub-xet-debugging "mention")

{% code overflow="wrap" %}

```bash

pip install -U huggingface_hub

hf download unsloth/GLM-4.7-Flash-GGUF \

--local-dir unsloth/GLM-4.7-Flash-GGUF \

--include "*UD-Q2_K_XL*"

```

{% endcode %}

{% endstep %}

{% step %}

その後、会話モードでモデルを実行します:

{% code overflow="wrap" %}

```bash

./llama.cpp/llama-cli \\

--model unsloth/GLM-4.7-Flash-GGUF/GLM-4.7-Flash-UD-Q4_K_XL.gguf \

--ctx-size 16384 \\

--seed 3407 \

--temp 1.0 \\

--top-p 0.95 \\

--min-p 0.01

```

{% endcode %}

また、 **コンテキストウィンドウ** 必要に応じて、 `202752`

{% endstep %}

{% endstepper %}

### :loop:反復とループの削減

{% hint style="success" %}

**1月21日更新: llama.cpp は、誤った** `"scoring_func": "softmax"` **を指定していたバグを修正しました。これがループと出力品質の低下を引き起こしていました(sigmoid であるべきでした)。GGUF を更新しました。より良い出力のため、モデルを再ダウンロードしてください。**

{% endhint %}

これにより、Z.ai の推奨パラメータを使って優れた結果を得られるようになりました:

* 一般的な用途では: `--temp 1.0 --top-p 0.95`

* ツール呼び出しでは: `--temp 0.7 --top-p 1.0`

* llama.cpp を使う場合は、 `--min-p 0.01` を設定してください。llama.cpp のデフォルトは 0.05 です。

* **リピートペナルティを無効にするのを忘れないでください!または** `--repeat-penalty 1.0`

追加しました `"scoring_func": "sigmoid"` を `config.json` メインモデル用に - [参照](https://huggingface.co/unsloth/GLM-4.7-Flash/commit/3fd53b491e04f707f307aef2f70f8a7520511e6d).

{% hint style="warning" %}

現時点では、 **推奨しません** この GGUF を **Ollama** で実行することは、チャットテンプレートの互換性問題が発生する可能性があるためです。GGUF は llama.cpp(または LM Studio、Jan などのバックエンド)ではうまく動作します。

{% endhint %}

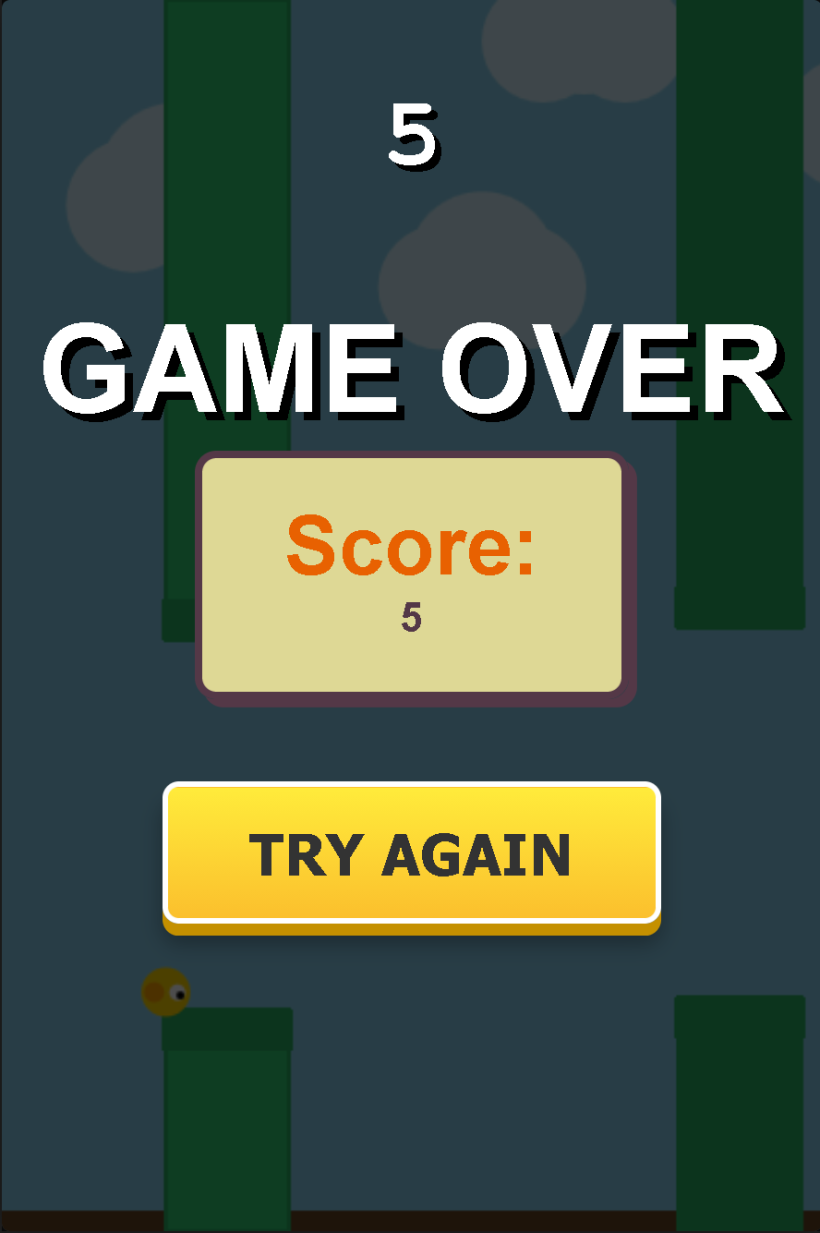

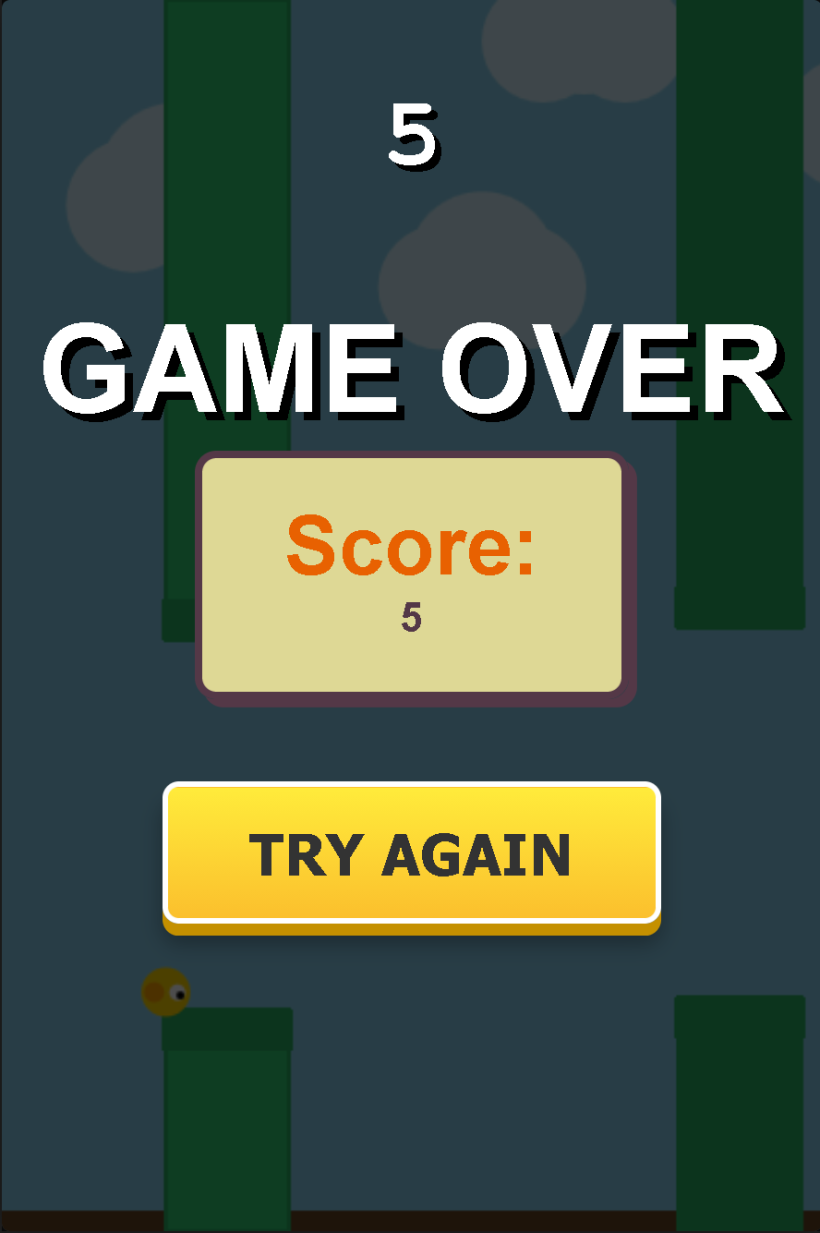

### :bird:UD-Q4\_K\_XL を使った Flappy Bird の例

例として、UD-Q4\_K\_XL を使って以下の長い会話を行いました `./llama.cpp/llama-cli --model unsloth/GLM-4.7-Flash-GGUF/GLM-4.7-Flash-UD-Q4_K_XL.gguf --fit on --temp 1.0 --top-p 0.95 --min-p 0.01` :

```

こんにちは

2+2 はいくつ?

Python で Flappy Bird のゲームを作って

Rust でまったく別のゲームを作って

両方のバグを見つけて

最初に言ったゲームを、単体の HTML ファイルで作って

バグを見つけて修正版のゲームを示して

```

その結果、次の Flappy Bird ゲームが HTML 形式でレンダリングされました:

HTML の Flappy Bird ゲーム(展開可能)

```html

Flappy Bird 修正版

0

FLAPPY

BIRD

タップまたはスペースキーで開始

```

そして、いくつかのスクリーンショットを取得しました(4bit で動作します):

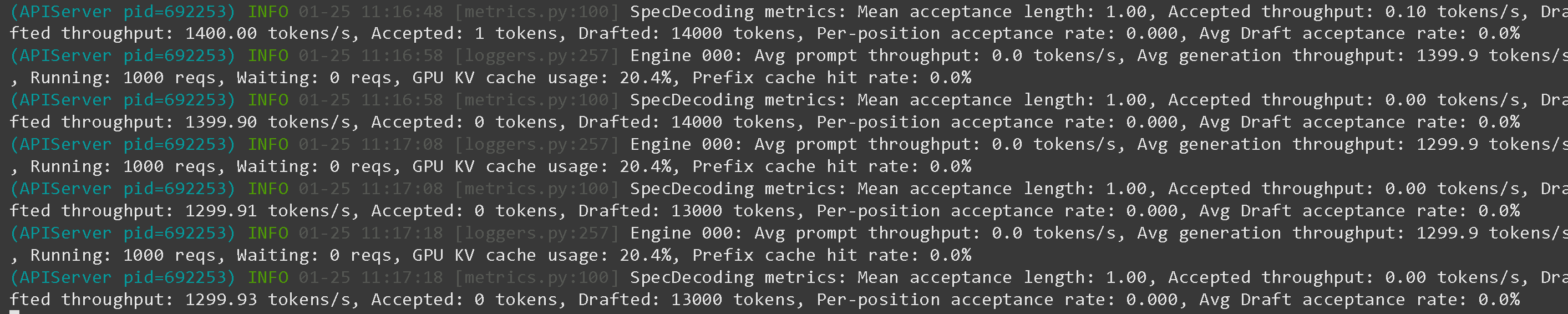

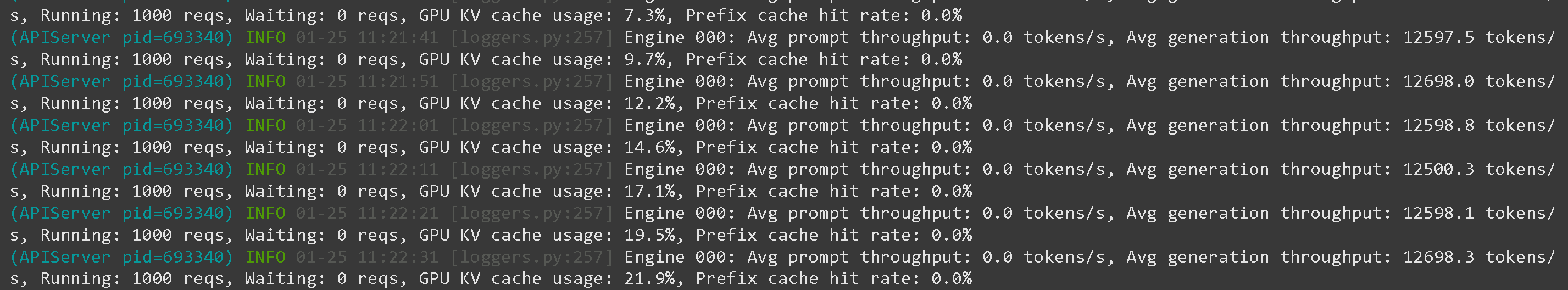

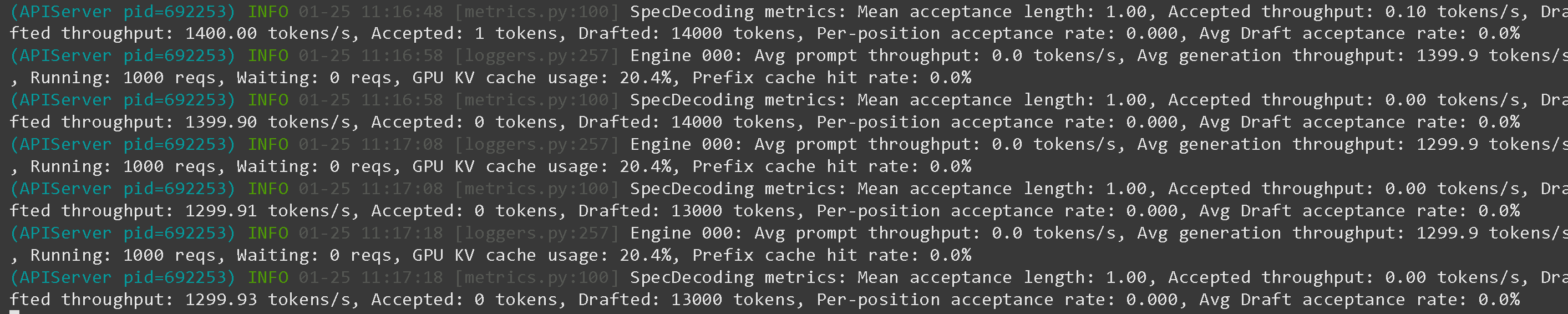

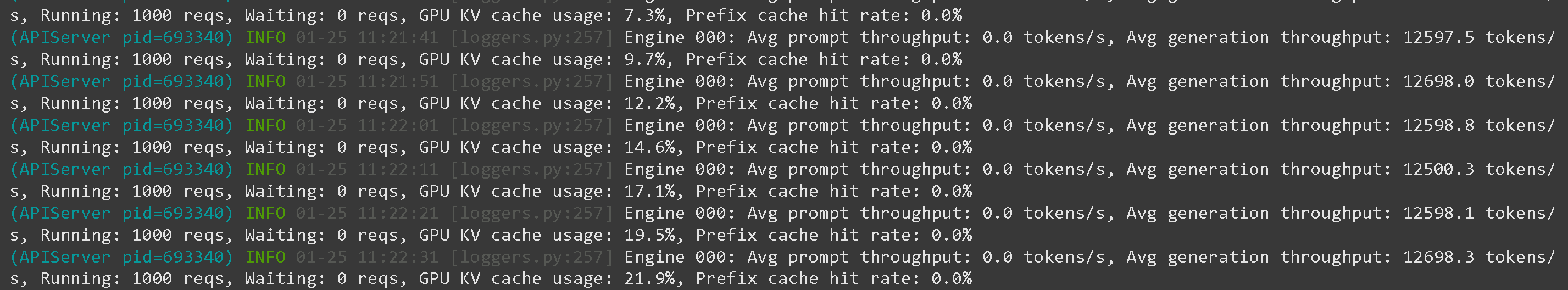

そして 1xB200 で 13,000 トークン/秒のスループット(それでもユーザーごとのデコードは 130 トークン/秒)

そして 1xB200 で 13,000 トークン/秒のスループット(それでもユーザーごとのデコードは 130 トークン/秒)

### :hammer:GLM-4.7-Flash でのツール呼び出し

参照 [tool-calling-guide-for-local-llms](https://unsloth.ai/docs/jp/ji-ben/tool-calling-guide-for-local-llms "mention") ツール呼び出しの方法の詳細はこちらをご覧ください。新しいターミナルで(tmux を使っている場合は CTRL+B+D)、2つの数値の加算、Python コードの実行、Linux 関数の実行など、いくつかのツールを作成します:

{% code expandable="true" %}

```python

import json, subprocess, random

from typing import Any

def add_number(a: float | str, b: float | str) -> float:

return float(a) + float(b)

def multiply_number(a: float | str, b: float | str) -> float:

return float(a) * float(b)

def substract_number(a: float | str, b: float | str) -> float:

return float(a) - float(b)

def write_a_story() -> str:

return random.choice([

"昔々、はるか彼方の銀河系で...",

"スロースとコードが大好きな2人の友達がいました...",

"すべてのスロースが超人的な知能を持つよう進化したため、世界は終わろうとしていました...",

"片方の友達は気づいていませんでしたが、もう一方は誤ってスロースを進化させるプログラムをコードしていました...",

])

def terminal(command: str) -> str:

if "rm" in command or "sudo" in command or "dd" in command or "chmod" in command:

msg = "'rm, sudo, dd, chmod' コマンドは危険なので実行できません"

print(msg); return msg

print(f"ターミナルコマンド `{command}` を実行中")

try:

return str(subprocess.run(command, capture_output = True, text = True, shell = True, check = True).stdout)

except subprocess.CalledProcessError as e:

return f"コマンドの実行に失敗しました: {e.stderr}"

def python(code: str) -> str:

data = {}

exec(code, data)

del data["__builtins__"]

return str(data)

MAP_FN = {

"add_number": add_number,

"multiply_number": multiply_number,

"substract_number": substract_number,

"write_a_story": write_a_story,

"terminal": terminal,

"python": python,

}

tools = [

{

"type": "function",

"function": {

"name": "add_number",

"description": "2つの数値を加算します。",

"parameters": {

"type": "object",

"properties": {

"a": {

"type": "string",

"description": "1つ目の数値。",

},

"b": {

"type": "string",

"description": "2つ目の数値。",

},

},

"required": ["a", "b"],

},

},

},

{

"type": "function",

"function": {

"name": "multiply_number",

"description": "2つの数値を乗算します。",

"parameters": {

"type": "object",

"properties": {

"a": {

"type": "string",

"description": "1つ目の数値。",

},

"b": {

"type": "string",

"description": "2つ目の数値。",

},

},

"required": ["a", "b"],

},

},

},

{

"type": "function",

"function": {

"name": "substract_number",

"description": "2つの数値を減算します。",

"parameters": {

"type": "object",

"properties": {

"a": {

"type": "string",

"description": "1つ目の数値。",

},

"b": {

"type": "string",

"description": "2つ目の数値。",

},

},

"required": ["a", "b"],

},

},

},

{

"type": "function",

"function": {

"name": "write_a_story",

"description": "ランダムな物語を書きます。",

"parameters": {

"type": "object",

"properties": {},

"required": [],

},

},

},

{

"type": "function",

"function": {

"name": "terminal",

"description": "ターミナルから操作を実行します。",

"parameters": {

"type": "object",

"properties": {

"command": {

"type": "string",

"description": "起動したいコマンド。例: `ls`, `rm`, ...",

},

},

"required": ["command"],

},

},

},

{

"type": "function",

"function": {

"name": "python",

"description": "実行される Python コードを指定して Python インタプリタを呼び出します。",

"parameters": {

"type": "object",

"properties": {

"code": {

"type": "string",

"description": "実行する Python コード",

},

},

"required": ["code"],

},

},

},

]

```

{% endcode %}

それから以下の関数を使用します(コピーして貼り付けて実行してください)。これにより関数呼び出しが自動的に解析され、任意のモデルに対して OpenAI エンドポイントが呼び出されます:

{% code overflow="wrap" expandable="true" %}

```python

from openai import OpenAI

def unsloth_inference(

messages,

temperature = 0.7,

top_p = 1.0,

top_k = -1,

repetition_penalty = 0.0,

):

messages = messages.copy()

openai_client = OpenAI(

base_url = "http://127.0.0.1:8001/v1",

api_key = "sk-no-key-required",

)

model_name = next(iter(openai_client.models.list())).id

print(f"使用モデル = {model_name}")

has_tool_calls = True

original_messages_len = len(messages)

while has_tool_calls:

print(f"現在のメッセージ = {messages}")

response = openai_client.chat.completions.create(

model = model_name,

messages = messages,

temperature = temperature,

top_p = top_p,

tools = tools if tools else None,

tool_choice = "auto" if tools else None,

extra_body = {"top_k": top_k, "min_p": min_p, "dry_multiplier" :repetition_penalty,}

)

tool_calls = response.choices[0].message.tool_calls or []

content = response.choices[0].message.content or ""

tool_calls_dict = [tc.to_dict() for tc in tool_calls] if tool_calls else tool_calls

messages.append({"role": "assistant", "tool_calls": tool_calls_dict, "content": content,})

for tool_call in tool_calls:

fx, args, _id = tool_call.function.name, tool_call.function.arguments, tool_call.id

out = MAP_FN[fx](**json.loads(args))

messages.append({"role": "tool", "tool_call_id": _id, "name": fx, "content": str(out),})

else:

has_tool_calls = False

return messages

```

{% endcode %}

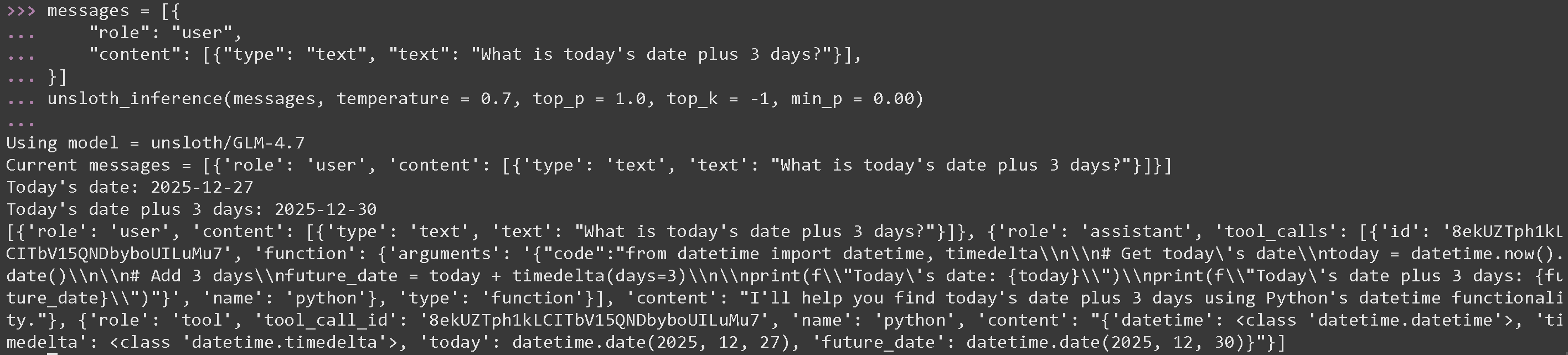

GLM-4.7-Flash を起動した後 `llama-server` のように [#deploy-with-llama-server-and-openais-completion-library](#deploy-with-llama-server-and-openais-completion-library "mention") または [tool-calling-guide-for-local-llms](https://unsloth.ai/docs/jp/ji-ben/tool-calling-guide-for-local-llms "mention") 詳細については、次にいくつかのツール呼び出しを行えます:

**GLM 4.7 の数値演算のためのツール呼び出し**

{% code overflow="wrap" %}

```python

messages = [{

"role": "user",

"content": [{"type": "text", "text": "今日の日付に3日を足すと何日ですか?"}],

}]

unsloth_inference(messages, temperature = 1.0, top_p = 0.95, top_k = -1, min_p = 0.01)

```

{% endcode %}

### :hammer:GLM-4.7-Flash でのツール呼び出し

参照 [tool-calling-guide-for-local-llms](https://unsloth.ai/docs/jp/ji-ben/tool-calling-guide-for-local-llms "mention") ツール呼び出しの方法の詳細はこちらをご覧ください。新しいターミナルで(tmux を使っている場合は CTRL+B+D)、2つの数値の加算、Python コードの実行、Linux 関数の実行など、いくつかのツールを作成します:

{% code expandable="true" %}

```python

import json, subprocess, random

from typing import Any

def add_number(a: float | str, b: float | str) -> float:

return float(a) + float(b)

def multiply_number(a: float | str, b: float | str) -> float:

return float(a) * float(b)

def substract_number(a: float | str, b: float | str) -> float:

return float(a) - float(b)

def write_a_story() -> str:

return random.choice([

"昔々、はるか彼方の銀河系で...",

"スロースとコードが大好きな2人の友達がいました...",

"すべてのスロースが超人的な知能を持つよう進化したため、世界は終わろうとしていました...",

"片方の友達は気づいていませんでしたが、もう一方は誤ってスロースを進化させるプログラムをコードしていました...",

])

def terminal(command: str) -> str:

if "rm" in command or "sudo" in command or "dd" in command or "chmod" in command:

msg = "'rm, sudo, dd, chmod' コマンドは危険なので実行できません"

print(msg); return msg

print(f"ターミナルコマンド `{command}` を実行中")

try:

return str(subprocess.run(command, capture_output = True, text = True, shell = True, check = True).stdout)

except subprocess.CalledProcessError as e:

return f"コマンドの実行に失敗しました: {e.stderr}"

def python(code: str) -> str:

data = {}

exec(code, data)

del data["__builtins__"]

return str(data)

MAP_FN = {

"add_number": add_number,

"multiply_number": multiply_number,

"substract_number": substract_number,

"write_a_story": write_a_story,

"terminal": terminal,

"python": python,

}

tools = [

{

"type": "function",

"function": {

"name": "add_number",

"description": "2つの数値を加算します。",

"parameters": {

"type": "object",

"properties": {

"a": {

"type": "string",

"description": "1つ目の数値。",

},

"b": {

"type": "string",

"description": "2つ目の数値。",

},

},

"required": ["a", "b"],

},

},

},

{

"type": "function",

"function": {

"name": "multiply_number",

"description": "2つの数値を乗算します。",

"parameters": {

"type": "object",

"properties": {

"a": {

"type": "string",

"description": "1つ目の数値。",

},

"b": {

"type": "string",

"description": "2つ目の数値。",

},

},

"required": ["a", "b"],

},

},

},

{

"type": "function",

"function": {

"name": "substract_number",

"description": "2つの数値を減算します。",

"parameters": {

"type": "object",

"properties": {

"a": {

"type": "string",

"description": "1つ目の数値。",

},

"b": {

"type": "string",

"description": "2つ目の数値。",

},

},

"required": ["a", "b"],

},

},

},

{

"type": "function",

"function": {

"name": "write_a_story",

"description": "ランダムな物語を書きます。",

"parameters": {

"type": "object",

"properties": {},

"required": [],

},

},

},

{

"type": "function",

"function": {

"name": "terminal",

"description": "ターミナルから操作を実行します。",

"parameters": {

"type": "object",

"properties": {

"command": {

"type": "string",

"description": "起動したいコマンド。例: `ls`, `rm`, ...",

},

},

"required": ["command"],

},

},

},

{

"type": "function",

"function": {

"name": "python",

"description": "実行される Python コードを指定して Python インタプリタを呼び出します。",

"parameters": {

"type": "object",

"properties": {

"code": {

"type": "string",

"description": "実行する Python コード",

},

},

"required": ["code"],

},

},

},

]

```

{% endcode %}

それから以下の関数を使用します(コピーして貼り付けて実行してください)。これにより関数呼び出しが自動的に解析され、任意のモデルに対して OpenAI エンドポイントが呼び出されます:

{% code overflow="wrap" expandable="true" %}

```python

from openai import OpenAI

def unsloth_inference(

messages,

temperature = 0.7,

top_p = 1.0,

top_k = -1,

repetition_penalty = 0.0,

):

messages = messages.copy()

openai_client = OpenAI(

base_url = "http://127.0.0.1:8001/v1",

api_key = "sk-no-key-required",

)

model_name = next(iter(openai_client.models.list())).id

print(f"使用モデル = {model_name}")

has_tool_calls = True

original_messages_len = len(messages)

while has_tool_calls:

print(f"現在のメッセージ = {messages}")

response = openai_client.chat.completions.create(

model = model_name,

messages = messages,

temperature = temperature,

top_p = top_p,

tools = tools if tools else None,

tool_choice = "auto" if tools else None,

extra_body = {"top_k": top_k, "min_p": min_p, "dry_multiplier" :repetition_penalty,}

)

tool_calls = response.choices[0].message.tool_calls or []

content = response.choices[0].message.content or ""

tool_calls_dict = [tc.to_dict() for tc in tool_calls] if tool_calls else tool_calls

messages.append({"role": "assistant", "tool_calls": tool_calls_dict, "content": content,})

for tool_call in tool_calls:

fx, args, _id = tool_call.function.name, tool_call.function.arguments, tool_call.id

out = MAP_FN[fx](**json.loads(args))

messages.append({"role": "tool", "tool_call_id": _id, "name": fx, "content": str(out),})

else:

has_tool_calls = False

return messages

```

{% endcode %}

GLM-4.7-Flash を起動した後 `llama-server` のように [#deploy-with-llama-server-and-openais-completion-library](#deploy-with-llama-server-and-openais-completion-library "mention") または [tool-calling-guide-for-local-llms](https://unsloth.ai/docs/jp/ji-ben/tool-calling-guide-for-local-llms "mention") 詳細については、次にいくつかのツール呼び出しを行えます:

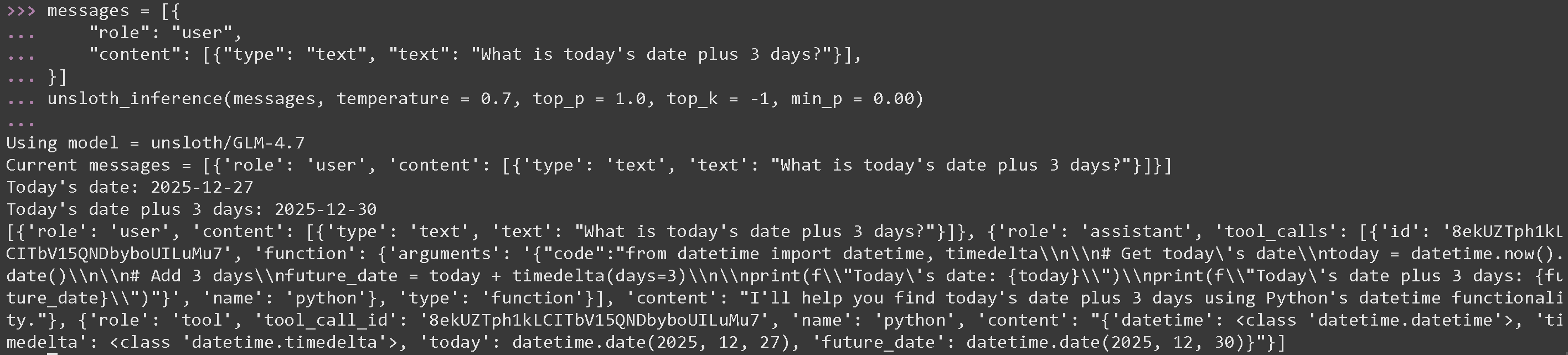

**GLM 4.7 の数値演算のためのツール呼び出し**

{% code overflow="wrap" %}

```python

messages = [{

"role": "user",

"content": [{"type": "text", "text": "今日の日付に3日を足すと何日ですか?"}],

}]

unsloth_inference(messages, temperature = 1.0, top_p = 0.95, top_k = -1, min_p = 0.01)

```

{% endcode %}

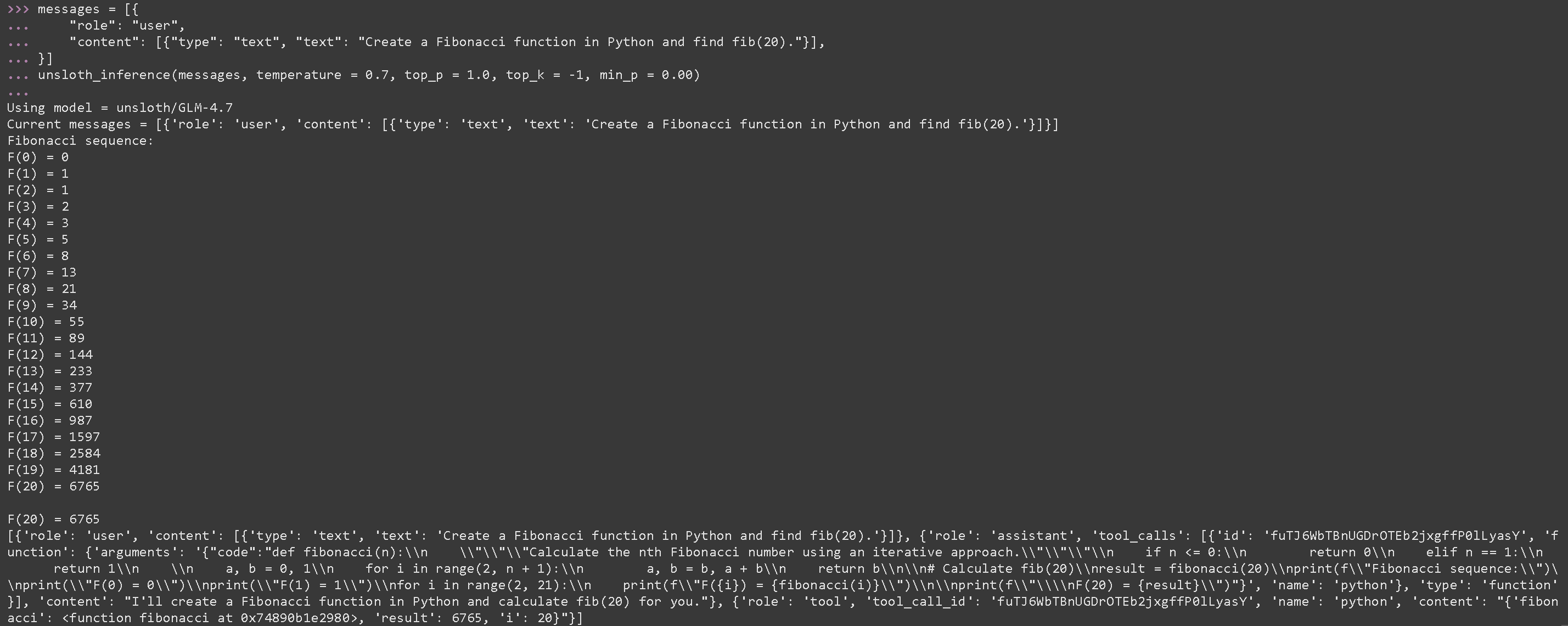

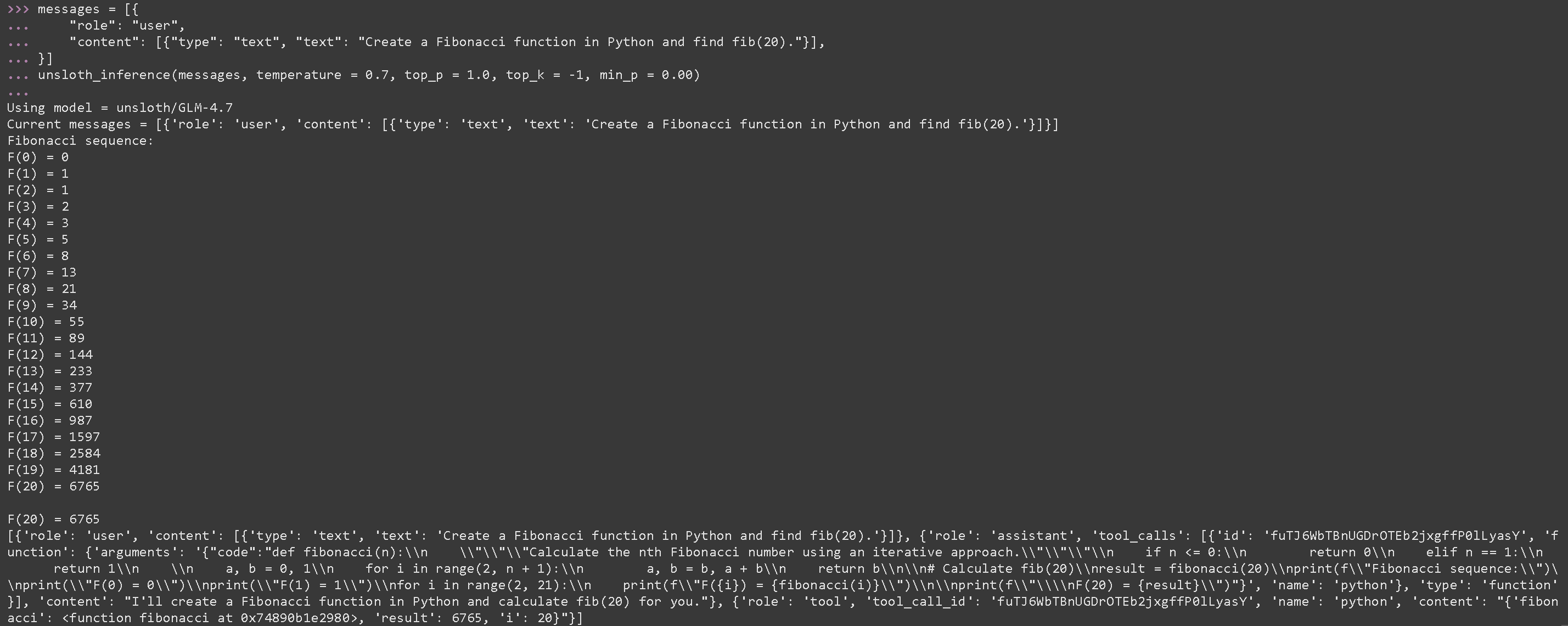

**GLM-4.7-Flash の生成された Python コードを実行するためのツール呼び出し**

{% code overflow="wrap" %}

```python

messages = [{

"role": "user",

"content": [{"type": "text", "text": "Python でフィボナッチ関数を作成し、fib(20) を求めてください。"}],

}]

unsloth_inference(messages, temperature = 1.0, top_p = 0.95, top_k = -1, min_p = 0.01)

```

{% endcode %}

**GLM-4.7-Flash の生成された Python コードを実行するためのツール呼び出し**

{% code overflow="wrap" %}

```python

messages = [{

"role": "user",

"content": [{"type": "text", "text": "Python でフィボナッチ関数を作成し、fib(20) を求めてください。"}],

}]

unsloth_inference(messages, temperature = 1.0, top_p = 0.95, top_k = -1, min_p = 0.01)

```

{% endcode %}

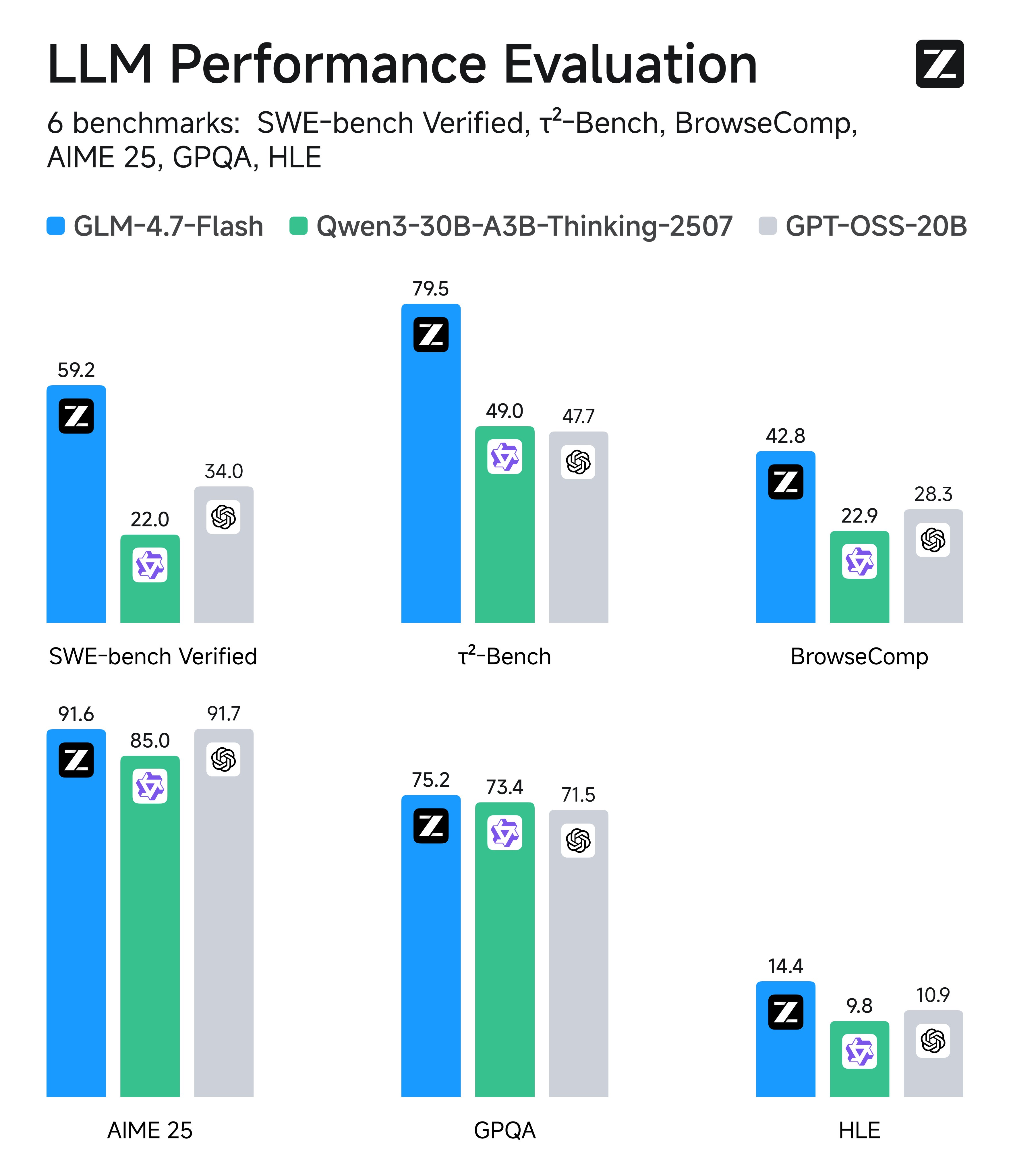

### ベンチマーク

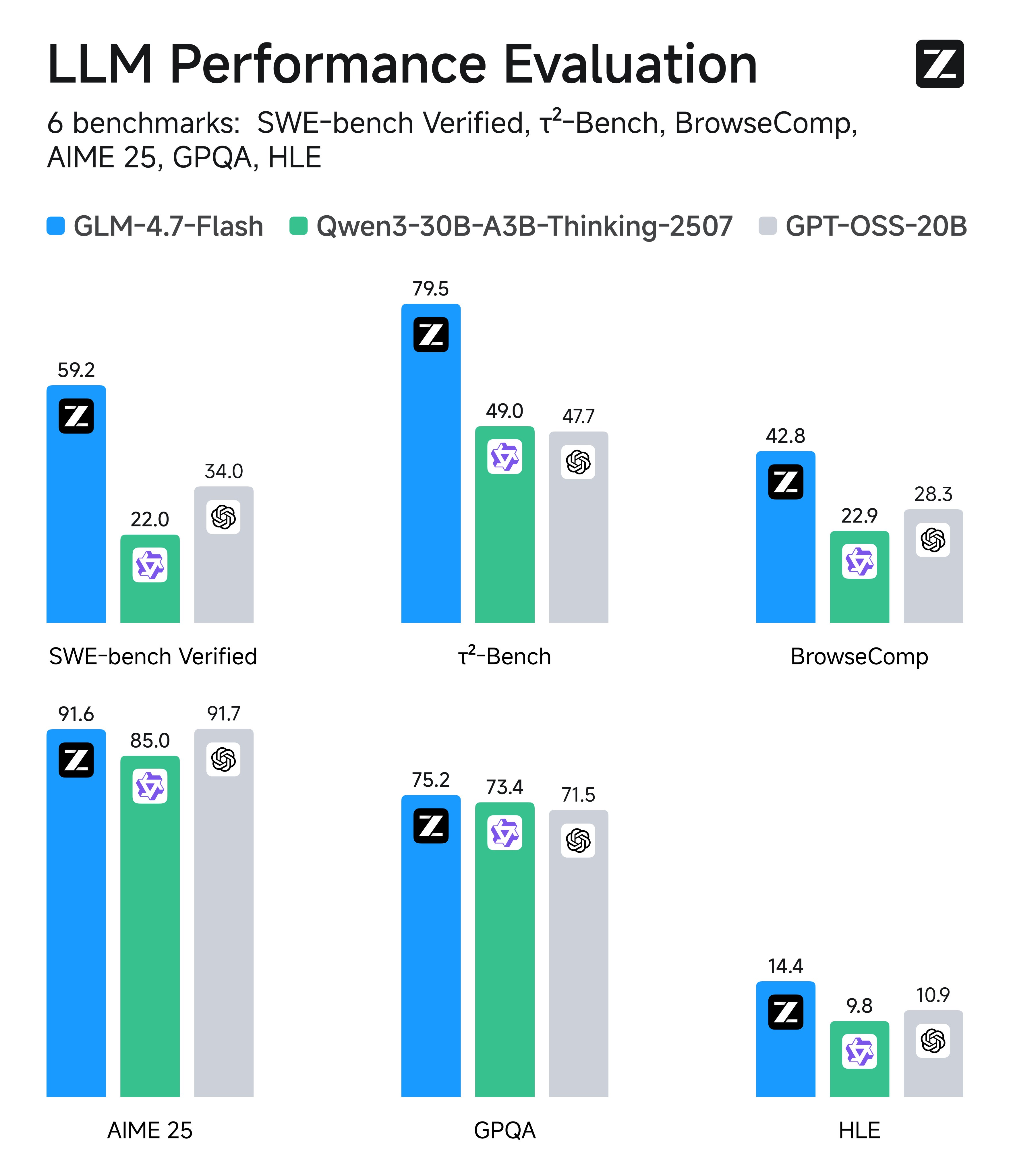

GLM-4.7-Flash は、AIME 25 を除くすべてのベンチマークで最高性能の 30B モデルです。

### ベンチマーク

GLM-4.7-Flash は、AIME 25 を除くすべてのベンチマークで最高性能の 30B モデルです。

| ベンチマーク | GLM-4.7-Flash | Qwen3-30B-A3B-Thinking-2507 | GPT-OSS-20B |

| ------------------ | ------------- | --------------------------- | ----------- |

| AIME 25 | 91.6 | 85.0 | 91.7 |

| GPQA | 75.2 | 73.4 | 71.5 |

| LCB v6 | 64.0 | 66.0 | 61.0 |

| HLE | 14.4 | 9.8 | 10.9 |

| SWE-bench Verified | 59.2 | 22.0 | 34.0 |

| τ²-Bench | 79.5 | 49.0 | 47.7 |

| BrowseComp | 42.8 | 2.29 | 28.3 |

---

# Agent Instructions: Querying This Documentation

If you need additional information that is not directly available in this page, you can query the documentation dynamically by asking a question.

Perform an HTTP GET request on the current page URL with the `ask` query parameter:

```

GET https://unsloth.ai/docs/jp/moderu/glm-4.7-flash.md?ask=

```

The question should be specific, self-contained, and written in natural language.

The response will contain a direct answer to the question and relevant excerpts and sources from the documentation.

Use this mechanism when the answer is not explicitly present in the current page, you need clarification or additional context, or you want to retrieve related documentation sections.

| ベンチマーク | GLM-4.7-Flash | Qwen3-30B-A3B-Thinking-2507 | GPT-OSS-20B |

| ------------------ | ------------- | --------------------------- | ----------- |

| AIME 25 | 91.6 | 85.0 | 91.7 |

| GPQA | 75.2 | 73.4 | 71.5 |

| LCB v6 | 64.0 | 66.0 | 61.0 |

| HLE | 14.4 | 9.8 | 10.9 |

| SWE-bench Verified | 59.2 | 22.0 | 34.0 |

| τ²-Bench | 79.5 | 49.0 | 47.7 |

| BrowseComp | 42.8 | 2.29 | 28.3 |

---

# Agent Instructions: Querying This Documentation

If you need additional information that is not directly available in this page, you can query the documentation dynamically by asking a question.

Perform an HTTP GET request on the current page URL with the `ask` query parameter:

```

GET https://unsloth.ai/docs/jp/moderu/glm-4.7-flash.md?ask=

```

The question should be specific, self-contained, and written in natural language.

The response will contain a direct answer to the question and relevant excerpts and sources from the documentation.

Use this mechanism when the answer is not explicitly present in the current page, you need clarification or additional context, or you want to retrieve related documentation sections.