| Qwen3.6 | 3 bits | 4 bits | 6 bits | 8 bits | BF16 |

|---|---|---|---|---|---|

| 35B-A3B | 17 Go | 23 Go | 30 Go | 38 Go | 70 Go |

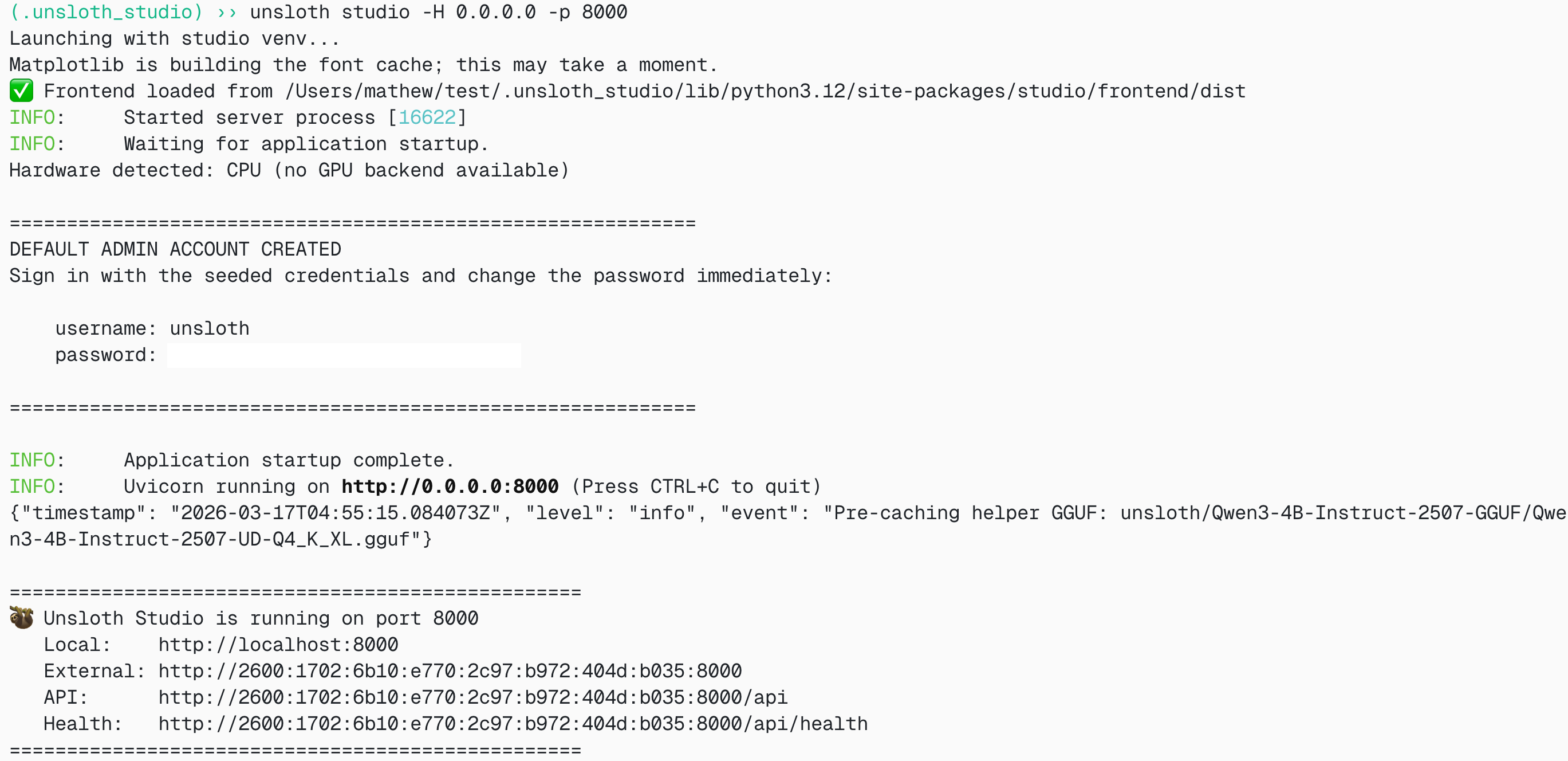

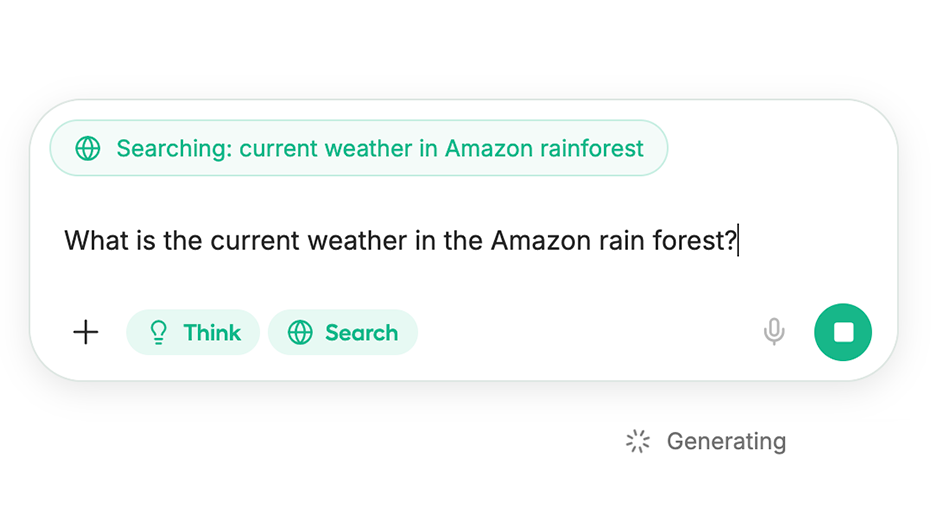

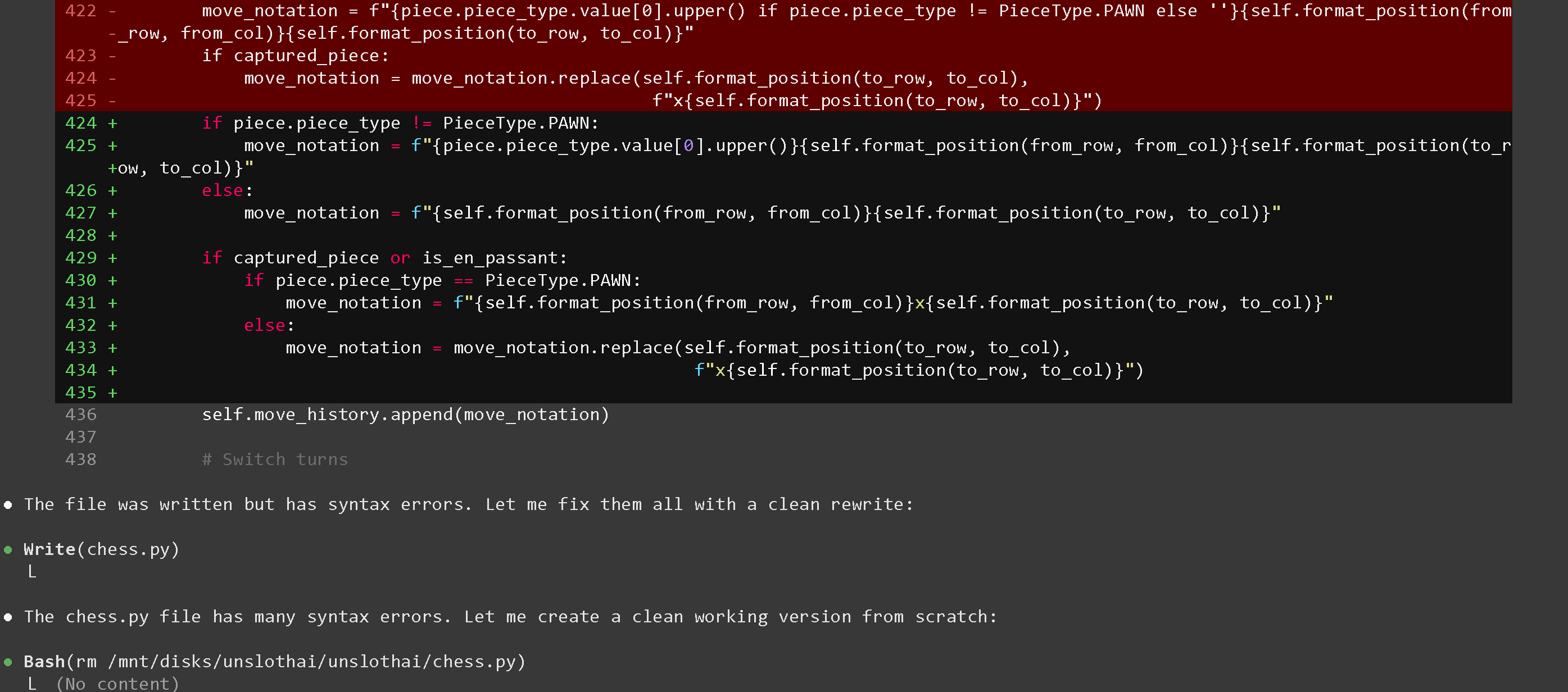

Unsloth Studio a le bouton Think activé par défaut

| OS llama-server : | Activer la réflexion | Désactiver la réflexion |

|---|---|---|

| Linux, MacOS, WSL : | | |

| Windows / Powershell : | | |

.png?alt=media&token=c62eef1c-fdd7-4838-8f69-bab227b56e23)

35B-A3B - benchmarks KLD (plus bas est meilleur)

.png?alt=media&token=f296d01d-311d-413e-8c62-122728e33008)